TTA, 유해표현 검출 AI로 LLM 데이터 품질 혁신

한국정보통신기술협회(TTA)가 대형언어모델(LLM) 학습용 데이터의 유해표현을 검출할 수 있는 인공지능(AI) 모델을 개발했다고 3일 밝혔다.

해당 모델은 한국지능정보사회진흥원(NIA)의 ‘2024년 초거대AI 학습용 데이터 품질검증 사업’의 일환으로 제작됐다.

TTA가 개발한 유해표현 검출 AI모델은 말뭉치 데이터에 포함된 문장의 유해성을 분석해 유해표현 여부를 판단하고, 해당 표현이 있으면 이를 카테고리별로 분류한다.

유해표현 유형은 국가인권위원회의 혐오표현 정의와 ‘혐오표현대항 안내서’를 참고해 3가지 유형과 11개 세부 카테고리로 설정됐다.

이 모델은 비속어가 아닌 문맥상 유해한 표현도 검출 가능하도록 설계됐다.

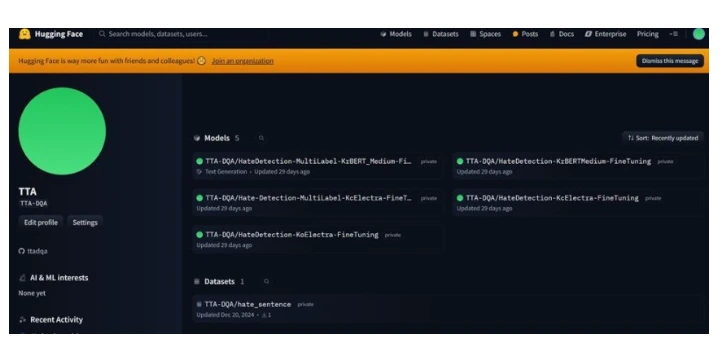

TTA는 개발한 모델과 학습 데이터를 AI 오픈소스 플랫폼 허깅페이스(Hugging Face)에 업로드했다.

이를 통해 누구나 API를 활용해 말뭉치 데이터의 유해성을 분석하고 유해 표현을 정제할 수 있다.

사용자는 KcELECTRA 및 KoBERT 등 다양한 Fine-Tuning 버전 중에서 선택해 활용 가능하다.

AI 서비스의 신뢰성과 안전성 확보가 중요한 가운데, 이번 AI모델은 생성형 AI 학습 데이터의 품질을 높이고, 윤리적 문제 발생을 줄이는 데 기여할 것으로 기대된다.

손승현 TTA 회장은 “최근 다양한 분야에서 생성형 AI 기술이 활발히 적용되면서, LLM 학습용 텍스트 데이터에 대한 수요가 급증하고 있으며, 이에 따라 LLM 기술의 윤리적 측면에 대한 사회적 관심도 높아지고 있다. 특히, 모델은 배운 대로 텍스트를 생성하기 때문에 학습용 텍스트에 포함된 유해 표현을 정제하는 과정이 반드시 필요하다”고 강조했다.

배동현 (grace8366@sabanamedia.com) 기사제보